A Meta AI-feltérképezés alatt azt az automatizált folyamatot értjük, amelyet a Meta alkalmaz a weboldalak tartalmának elérésére és indexelésére mesterséges intelligencia modelljeinek betanítása céljából. Azok számára a weboldal tulajdonosok számára, akik hirdetési bevételektől függenek, már nem csupán opcionális kérdés, hogy megértsék, hogyan lehet blokkolni a Meta AI-t. Ez egy üzleti döntés, amelynek komoly pénzügyi következményei vannak.

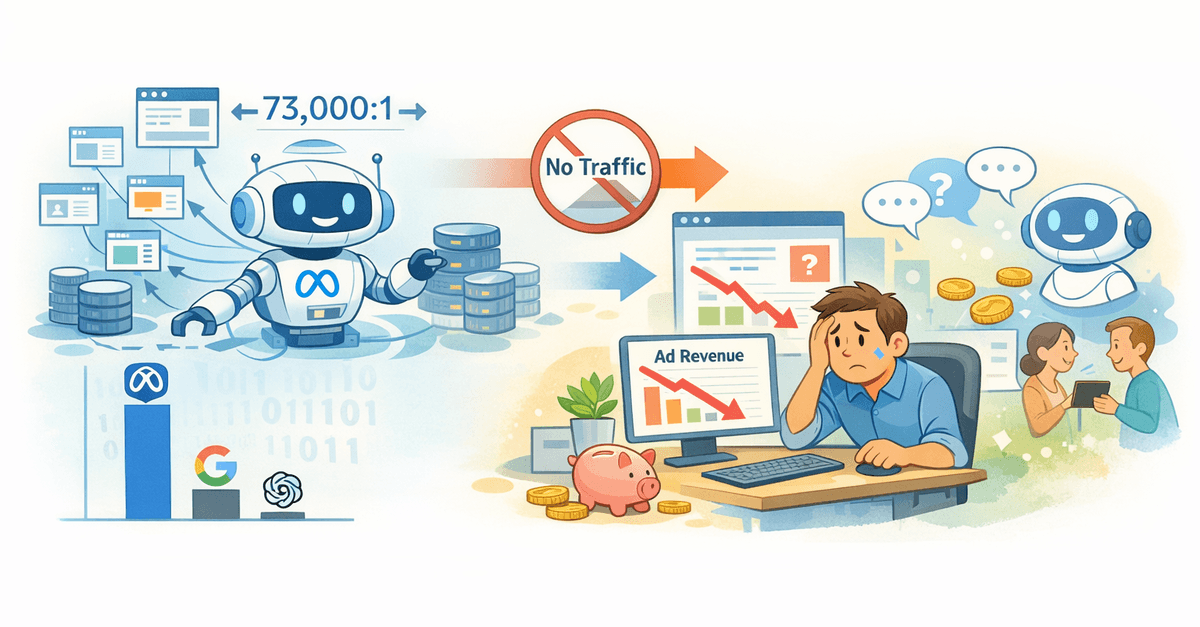

A tét jelentős. A Cloudflare 2025. júliusi adatai szerint a Meta AI-crawlerei önmagukban az összes AI-crawler-forgalom 52%-át generálják, ami több mint kétszerese a Google és az OpenAI együttes forgalmának. A Meta crawl-to-referral aránya körülbelül 73 000:1, ami azt jelenti, hogy a Meta rendkívüli mértékben von ki tartalmat a webhelyéről, miközben cserébe gyakorlatilag semmilyen forgalmat nem küld.

Ez az egyensúlyhiány alapvetően megszakítja a hagyományos tartalomgyártó-kereső kapcsolatot. A keresőmotorok történelmileg a forgalom generálása fejében indexelték a tartalmakat. Az AI-crawlerek a tartalmadat olyan modellek betanítására használják, amelyek valójában csökkenthetik a forgalmadat azáltal, hogy olyan válaszmotorokat táplálnak, amelyek megakadályozzák a felhasználókat abban, hogy rákattintsanak a webhelyedre.

Ha mérlegeled, hogy a blokkolás egyáltalán a megfelelő stratégia-e a helyzetedben, a teljes kiadói útmutatónk az AI-crawlerekről kitér arra, hogy blokkolj, engedélyezz vagy optimalizálj a maximális bevétel érdekében.

## A meta-keresőrobotok világa: Ismerd meg a botokat

A Meta több webes keresőrobotot is üzemeltet, és a köztük lévő különbségek valójában igen jelentősek. Ha tisztában vagy azzal, hogy melyik bot mire szolgál, elkerülheted, hogy véletlenül tönkretegye a közösségi média jelenlétedet, miközben a tartalmaidat próbálod megvédeni a mesterséges intelligencia (AI) betanításától. A vállalat az AI-hez kapcsolódó keresőrobot-tevékenységeiről lényegesen kevésbé volt átlátható, mint más technológiai óriások. 2024 augusztusában a Meta hivatalos bejelentés nélkül csendben elindította a meta-externalagentet, így a kiadóknak nagy nehezen kellett megérteniük, hogy mit is csinál ez az új bot a szervereiken.

### A Meta főbb keresőrobotjainak bemutatása

Íme, amit tudnod kell a jelenleg aktív Meta-robotokról.

| Keresőrobot neve | User Agent String | Fő cél | AI tanításra használt? | Tiltás hatása |

|---|---|---|---|---|

| facebookexternalhit | facebookexternalhit/1.1 | Link-előnézet létrehozása Facebookon, Instagramon és a Messengerben történő megosztáshoz | Nem egyértelmű (esetleg kettős felhasználású) | Letiltása nehézségeket okoz Facebook bejegyzések megosztásakor, előnézeti képe nem tud betöltődni. |

| meta-externalagent | meta-externalagent/1.1 | Mesterséges intelligencia modellek betanítása és tartalom indexelése | Igen (megerősítve) | Leállítja az AI-tanítást; nincs hatással a linkek előnézetére |

| FacebookBot | FacebookBot/1.0 | Beszédfelismerés és nyelvi modellek betanítása | Igen | A felhasználókra gyakorolt hatás minimális |

| Meta-ExternalFetcher | Meta-ExternalFetcher/1.0 | AI-asszisztens által végzett feladatok | Igen | Hatással van a Meta AI keresési funkcióira |

A legfontosabb különbség itt a „facebookexternalhit” és a „meta-externalagent” között van. Az előbbi már évek óta létezik, és azokat a szép link-előnézeteket generálja, amikor valaki megosztja a cikkedet a Facebookon. Az utóbbi pedig a Meta saját, mesterséges intelligenciára specializálódott keresőrobotja.

## Hogyan lehet letiltani a Meta AI-t a robots.txt fájl segítségével

A robots.txt fájl továbbra is a legelterjedtebb módszer a keresőrobotok számára a weboldal feltérképezésére vonatkozó preferenciák közlésére. A Meta-specifikus utasítások hozzáadása ehhez a fájlhoz körülbelül 30 másodpercet vesz igénybe, és semmilyen technikai szakértelmet nem igényel. Ez a módszer a legkönnyebben megvalósítható megoldás a weboldal-tulajdonosok számára, ha meg akarják akadályozni a Meta AI hozzáférését a weboldalukhoz.

### Alapvető Meta AI-blokkolási utasítások

Ha meg akarod akadályozni a Meta mesterséges intelligenciájának betanító robotjait, de közben meg akarod őrizni a linkek előnézeti funkcióját, írd be ezeket a sorokat a robots.txt fájlba:

# A Meta AI keresőrobotok blokkolása

User-agent: meta-externalagent

Disallow: /

User-agent: Meta-ExternalAgent

Disallow: /

User-agent: FacebookBot

Disallow: /

User-agent: Meta-ExternalFetcher

Disallow: /

Ez a beállítás leállítja az AI-alapú kereső robotokat, miközben lehetővé teszi a link-előnézeti keresőrobot számára, hogy elvégezze a feladatát. A megosztott linkjeid továbbra is jól fognak kinézni a Facebookon és az Instagramon.

### A totális tiltás: minden Meta elérést letiltani

Egyes weboldal készítők nem akarnak semmilyen Meta-keresőrobotot használni. Ha ez a helyzet nálad is, itt van egy átfogó blokkoló kód, amellyel minden Meta AI- és közösségi média-keresőrobotot leállíthatsz:

User-agent: facebookexternalhit

Disallow: /

User-agent: meta-externalagent

Disallow: /

User-agent: Meta-ExternalAgent

Disallow: /

User-agent: FacebookBot

Disallow: /

User-agent: Meta-ExternalFetcher

Disallow: /

User-agent: Facebot

Disallow: /

Figyelem: ha ezt végrehajtod, a megosztott linkjeid szörnyen fognak kinézni. Se képek, se leírások, csak puszta URL-ek. Ha a közösségi médiából érkező forgalom fontos a hirdetési bevételeid szempontjából, gondold át alaposan, mielőtt ilyen drasztikus lépésre szánod magad.

A robots.txt-fájl bizalmi problémája

Itt kezdődnek a problémák. A robots.txt alapvetően egy bizalmi rendszer” és több webhely-üzemeltető is arról számolt be, hogy a Meta keresőrobotjai nem mindig tartják tiszteletben ezeket az utasításokat. Egyes webmesterek dokumentálták, hogy a meta-externalagent a robots.txt-fájlban szereplő kifejezett tiltások ellenére is folytatta webhelyeik feltérképezését. Egy webhely-üzemeltető arról számolt be, hogy egyetlen nap alatt több mint 148 000 kérést kapott a Meta mesterséges intelligenciával működő keresőrobotjától, ami gyakorlatilag szolgáltatásmegtagadási helyzetet eredményezett. A szabályok betartásával kapcsolatos probléma azt jelenti, hogy a robots.txt fájl nem feltétlenül elegendő. Lehet, hogy szerver szintű beavatkozásra lesz szükség a Meta AI-keresőrobotok valódi blokkolásához. Az összes rendelkezésre álló blokkolási módszer átfogó bemutatásához technikai útmutatónk az AI-robotok webhelyéről való blokkolásáról mindenre kiterjed, az alapvető utasításoktól a fejlett tűzfal-konfigurációkig.

Szerver szintű blokkolás: amikor a robots.txt nem elegendő

Azok számára, akik udvarias kérések helyett garantált védelmet szeretnének, a szerverkonfiguráció biztosítja a tényleges érvényesítést. Ezek a módszerek hibaüzeneteket küldenek vissza a keresőrobotoknak, ahelyett, hogy arra számítanának, azok elolvassák és betartják a robots.txt fájlt.

Apache .htaccess konfiguráció

A Meta AI keresőrobotok szerver szintű letiltásához írd be ezeket a sorokat a .htaccess fájlba:

RewriteEngine On

# Block meta-externalagent

RewriteCond %{HTTP_USER_AGENT} meta-externalagent [NC]

RewriteRule .* - [F,L]

# Block FacebookBot

RewriteCond %{HTTP_USER_AGENT} FacebookBot [NC]

RewriteRule .* - [F,L]

# Block Meta-ExternalFetcher

RewriteCond %{HTTP_USER_AGENT} Meta-ExternalFetcher [NC]

RewriteRule .* - [F,L]

Vagy egy szabályban:

RewriteEngine On

RewriteCond %{HTTP_USER_AGENT} ^.*(meta-externalagent|FacebookBot|Meta-ExternalFetcher).*$ [NC]

RewriteRule .* - [F,L]

Ez a beállítás 403-as „Forbidden” hibát ad vissza minden olyan kérésre, amely ezeknek a felhasználói ügynököknek felel meg.

Nginx konfiguráció

Nginx-kiszolgálók esetén ezt írja be a szerverblokkba vagy egy külön konfigurációs fájlba:

if ($http_user_agent ~* "(meta-externalagent|FacebookBot|Meta-ExternalFetcher)") {

return 403;

}

Egyes rendszergazdák inkább egy átfogóbb reguláris kifejezést részesítenek előnyben, amely a különböző változatokat is felismeri:

if ($http_user_agent ~* "(meta-externalagent|Meta-ExternalAgent|FacebookBot|Meta-ExternalFetcher|facebookexternalhit)") {

return 403;

}

Cloudflare-felhasználók: Egygombos megoldás

A Cloudflare 2024 júliusában vezette be az egy kattintással működő AI-bot-blokkoló funkciót, és már több mint egymillió webhely aktiválta azt. Ez a megoldás nem igényel technikai beállítást.

Lépjen a Cloudflare irányítópultján a “Overview” menüpontra. Kapcsolja be az „Control AI crawlers” opciót az ismert AI-tanító botok – többek között a Meta crawlereinek – automatikus blokkolásához.

A Cloudflare részletes beállítási lehetőségeket is kínál, ha bizonyos botokat szeretne blokkolni, míg másokat engedélyezni. A platform emellett kezelt robots.txt funkciókat is biztosít, amelyek automatikusan hozzáadják a megfelelő utasításokat az AI-crawlerekhez, az “AI Crawl Control” menüpont alatt.

Alternatív stratégiák a tartalom védelmére

A blokkoláson túl a weboldal-tulajdonosoknak más lehetőségeik is vannak az AI-alapú keresőrobotok hozzáférésének kezelésére. Egyes weboldal-tulajdonosok rájönnek, hogy az AI teljes blokkolása helyett érdemesebb arra ösztönözni az AI-eszközöket, hogy hivatkozzanak a weboldalukra, mint alternatív stratégiát, amely valójában forgalmat generálhat, ahelyett, hogy megakadályozná a hozzáférést.

A meta-címkék használata

Adja hozzá ezeket a kísérleti meta-címkéket az oldal fejlécéhez. Ezek jelzik a mesterséges intelligencia által működtetett keresőrobotoknak, hogy nem szeretné, ha a tartalmát gépi tanuláshoz használnák:

<meta name="robots" content="noai, noimageai">

Ezek a címkék nem szabványosítottak, és alkalmazásuk önkéntes alapon történik, de a mesterséges intelligencia rendszerekkel való kommunikáció újabb szintjét jelentik.

2026-03-26